LG AI연구원이 18일 캐나다 밴쿠버에서 진행 중인 세계 최대 컴퓨터 비전 학회 ‘CVPR(Computer Vision and Pattern Recognition, 컴퓨터 비전 및 패턴 인식) 2023’에서 ‘캡셔닝 AI(Captioning AI)’를 처음 공개했다.

LG AI연구원이 처음으로 공개한 ‘캡셔닝 AI’는 ‘인간처럼 처음 보는 이미지까지 자연어로 설명할 수 있는 AI’로 이미지 검색에 활용할 수 있는 정보인 문장이나 키워드 등 메타 데이터를 생성한다.

18일 진행한 워크숍에서 이홍락 LG AI연구원 CSAI가 캡셔닝 AI에 적용한 제로샷 이미지 캡셔닝 기술에 대해 설명하고 있다.

▲18일(현지시간) 진행한 워크숍에서 이홍락 LG AI연구원 CSAI가 캡셔닝 AI에 적용한 제로샷 이미지 캡셔닝 기술에 대해 설명하고 있다.

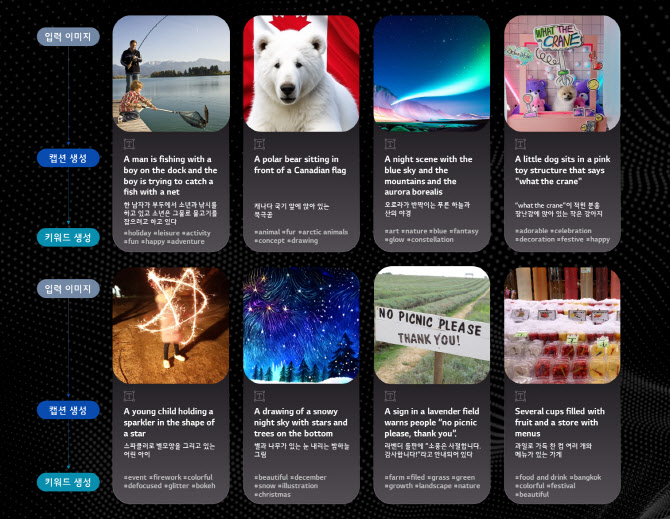

이미지 상의 다양한 요소와 특징을 인식해 설명글과 키워드를 생성하는 캡셔닝 AI(Captioning AI)

▲이미지 상의 다양한 요소와 특징을 인식해 설명글과 키워드를 생성하는 캡셔닝 AI(Captioning AI)

LG AI연구원은 AI가 인간처럼 처음 보는 물체나 장면에 대해서도 이전의 경험과 지식을 활용해 이해하고 설명할 수 있도록 ‘제로샷 이미지 캡셔닝(Zero-shot Image Captioning)’ 기술을 적용했다.

‘제로샷 이미지 캡셔닝’은 AI가 기존에 학습한 대량의 이미지와 텍스트 데이터를 기반으로 배경, 인물, 행동 등 이미지 상의 다양한 요소와 특징을 인식하고, 그 관계를 이해하고 설명할 수 있게 하는 기술이다.

‘캡셔닝 AI’는 대량의 이미지를 관리해야 하는 기업들의 업무 효율성과 생산성을 높일 수 있다. ‘캡셔닝 AI’는 문장이나 단어의 길이와 개수에 따라 다르지만 평균적으로 5개 문장과 10개의 키워드를 10초 내에 생성한다. 이미지 범위를 1만 장으로 확장하면 2일 이내에 작업을 끝낼 수 있어 빠른 시간 내에 맞춤형 이미지 검색·관리 시스템 구축이 가능하다.

‘캡셔닝 AI’는 LG AI연구원과 셔터스톡(Shutterstock)의 긴밀한 협력이 있어 가능했다.

셔터스톡은 이미지와 영상 등 시각 콘텐츠가 매일 수십만 개 이상 새롭게 추가되는 세계 최대 플랫폼 기업으로 콘텐츠를 분석하고 처리하는 경험이 풍부한 전문가들이 포진해 있다.

LG AI연구원은 이미지 분류와 검색에 활용하기 적합한 문장의 길이나 표현 방법 등 이미지 캡셔닝에 관한 방대한 노하우를 가지고 있는 셔터스톡과 데이터 학습부터 서비스 개발까지 함께해 완성도를 높였다.

특히, LG AI연구원과 셔터스톡은 실용적이면서도 신뢰할 수 있는 AI 모델 개발을 위해 학습 데이터의 편향성·선정성 등 AI 윤리 검증을 진행하고, 저작권 투명성도 확보했다.

세잘 아민(Sejal Amin) 셔터스톡 CTO는 “현재 글로벌 고객사 10곳을 대상으로 ‘얼리 액세스(앞서 해보기) 프로그램’을 진행하며 캡셔닝 AI 기술을 발전시켜 나가고 있다”며, “캡셔닝 AI는 고객들이 반복적인 작업보다 좀 더 본질적이고 창의적인 일에 집중할 수 있도록 돕는 AI가 될 것”이라고 강조했다.

LG AI연구원은 학회 기간 중 LG 부스를 방문한 연구자들을 대상으로 ‘캡셔닝 AI’ 서비스를 시연할 계획이다.

(출처 :비지니스코리아)